前言

接到这个需求,还是有些心虚的,原因有二,一是,业务需要,时间紧;二是,实现这个功能MongoDB聚合感觉有些复杂,聚合要走好多步。

记录1

{

"_id" : ObjectId("5c1e23eaa66bf62c0c390afb"),

"_class" : "C1",

"resourceUrl" : "/static/js/p.js",

"refererDomain" : "1234",

"resourceType" : "static_resource",

"ip" : "17.17.13.13",

"createTime" : ISODate("2018-12-22T19:45:46.015+08:00"),

"disabled" : 0

}

记录2

{

"_id" : ObjectId("5c1e23eaa66bf62c0c390afb"),

"_class" : "C1",

"resourceUrl" : "/static/js/p.js",

"refererDomain" : "1234",

"resourceType" : "Dome_resource",

"ip" : "17.17.13.14",

"createTime" : ISODate("2018-12-21T19:45:46.015+08:00"),

"disabled" : 0

}

记录3

{

"_id" : ObjectId("5c1e23eaa66bf62c0c390afb"),

"_class" : "C2",

"resourceUrl" : "/static/js/p.js",

"refererDomain" : "1235",

"resourceType" : "static_resource",

"ip" : "17.17.13.13",

"createTime" : ISODate("2018-12-20T19:45:46.015+08:00"),

"disabled" : 0

}

记录4

{

"_id" : ObjectId("5c1e23eaa66bf62c0c390afb"),

"_class" : "C2",

"resourceUrl" : "/static/js/p.js",

"refererDomain" : "1235",

"resourceType" : "Dome_resource",

"ip" : "17.17.13.13",

"createTime" : ISODate("2018-12-20T19:45:46.015+08:00"),

"disabled" : 0

}

最后,问题处理方案如下。

实现代码如下:

db.log_resources_access_collect.aggregate(

[

{ $group: { _id: "$refererDomain" } },

{ $out : "mt_resources_access_log20190122" }

]

)

代码解释,处理的逻辑为,循环逐笔取出mt_resources_access_log20190122的数据(共95笔),每笔逐行加工处理,处理的逻辑主要是 根据自己的_id字段数据(此字段来自mt_resources_access_log聚合前的refererDomain字段), 去和 mt_resources_access_log的字段 refererDomain比对,查询出符合此条件的数据,并且是按_id 倒序,仅取一笔,最后将Join刷选后的数据Insert到集合mt_resources_access_log_new。

db.mt_resources_access_log20190122.find({}).forEach(

function(x) {

db.mt_resources_access_log.find({ "refererDomain": x._id }).sort({ _id: -1 }).limit(1).forEach(

function(y) {

db.mt_resources_access_log_new.insert(y)

}

)

}

)

刷选前集合mt_resources_access_log的数据量为1500多W。

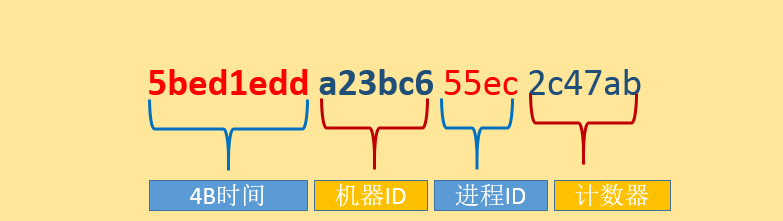

注意:根据时间排序的要求,因为部分文档没有createTime字段类型,且 createTime字段上没有创建索引,所以未了符合按时间排序我们采用了sort({_id:1})的变通方法,因为_id 还有时间的意义。下面的内容为MongoDB对应_id 的相关知识。总结

注意:根据时间排序的要求,因为部分文档没有createTime字段类型,且 createTime字段上没有创建索引,所以未了符合按时间排序我们采用了sort({_id:1})的变通方法,因为_id 还有时间的意义。下面的内容为MongoDB对应_id 的相关知识。总结

以上就是这篇文章的全部内容了,希望本文的内容对大家的学习或者工作具有一定的参考学习价值,如果有疑问大家可以留言交流,谢谢大家对自学php网的支持。